El CEO de Microsoft AI, Mustafa Suleyman, ha anunciado en X los primeros modelos de IA creados íntegramente en casa por Microsoft: MAI-Voice-1 y MAI-1-preview. El estreno llega acompañado de Copilot Audio Expressions, un experimento en Copilot Labs para generar voz realista desde texto.

Dos modelos propios para acelerar Copilot

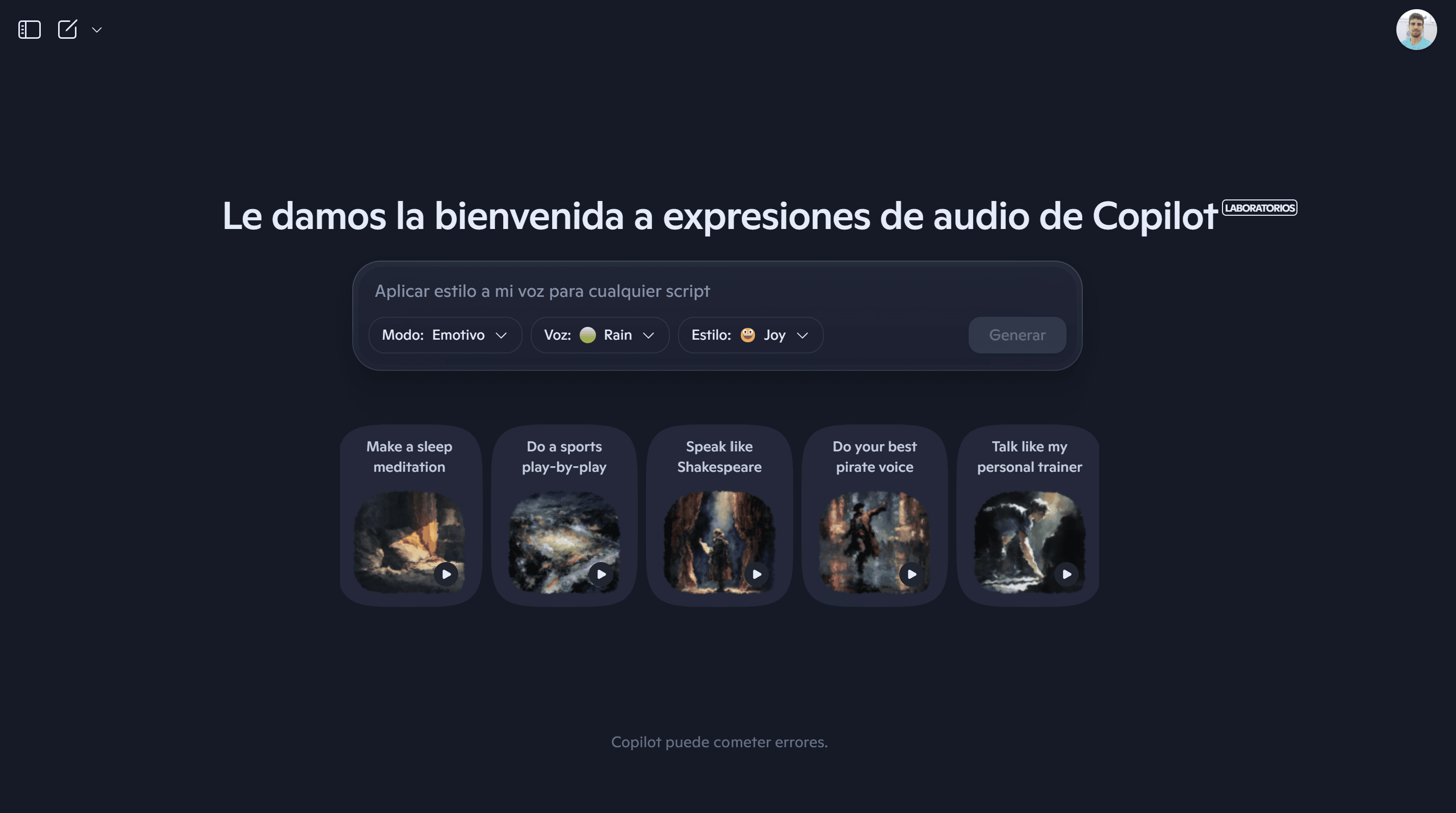

MAI-Voice-1 es un modelo de síntesis de voz centrado en expresividad y eficiencia. Microsoft asegura que puede generar un minuto de audio en menos de un segundo con una sola GPU, y ya se está integrando en experiencias como Copilot Daily y formatos estilo podcast. Además, cualquiera puede probar voces, estilos y tonos en el nuevo experimento Copilot Audio Expressions dentro de Copilot Labs.

Por su parte, MAI-1-preview es un modelo lingüístico con arquitectura mixture-of-experts (MoE) pre- y post-entrenado en ~15.000 GPU NVIDIA H100. Microsoft lo describe como un modelo orientado al usuario final, especializado en seguir instrucciones y responder consultas cotidianas. Ya puede ponerse a prueba en LMArena mientras la compañía lo va integrando dentro de Copilot junto a otros modelos a lo largo de las próximas semanas.

Este movimiento de Microsoft demuestra su férrea voluntad de lograr una mayor independencia tras años apoyándose en terceros (como OpenAI), complementando sus alianzas actuales. A nivel estratégico, disponer de modelos propios acorta ciclos de integración, optimiza costes y facilita el cumplimiento regulatorio al controlar la cadena de valor de la IA.

Los de Redmond han hecho una importante inversión en Microsoft AI, fichando a golpe de talonario a algunos de los mayores talentos vinculados a la inteligencia artificial y poniendo al frente a alguien como Mustafa Suleyman, fundador de DeepMind e Inflection. Los primeros frutos de esta gran inversión los estamos comenzando a ver en las últimas semanas cargadas de novedades como la búsqueda semántica y el nuevo home en la app de Copilot de Windows 11, el nuedo modo «Estudio y aprendizaje» o la alianza con Samsung para llevar Copilot a sus monitores y televisores.

¿Cómo probarlo ya?

Entra en Copilot Labs y abre Audio Expressions: pega un texto, elige voz, estilo y tono, y genera el clip (con opción de descarga). Es una prueba de concepto que puede evolucionar o retirarse, como ocurre con todo lo experimental en Labs.

Esto tendrá que ver con la futura salida a bolsa de Open AI?, se decía que les ofrecen el 30’% de participación si renunciaban a privilegios de su tecnología.. con esto estaría confirmándose ese acuerdo.