Hoy tenemos que hablar de una nueva patente concedida a Microsoft por la Oficina de Patentes y Marcas de los Estados Unidos (USPTO). Esta revela que la empresa está trabajando en agentes conversacionales que reflejan el estilo de conversación y/o las expresiones faciales de los usuarios.

La patente, Linguistic Style Matching Agent, fue concedida a Microsoft el 3 de septiembre de 2020, y acredita a Daniel J McDuff, Kael R. Rowan, Mary P Czerwinski, Deepali Aneja y Rens Hoegen como inventores.

Microsoft busca evolucionar los agentes virtuales y chats

Con los avances en el reconocimiento de voz y los modelos de diálogo generativo, las interfaces conversacionales como chatbots y agentes virtuales son cada vez más populares. Mientras que las interacciones del lenguaje natural han evolucionado las interacciones humano-ordenador, la comunicación es monotónica y limitada. Estas conversaciones, por lo tanto, terminan siendo sólo transaccionales y no son muy naturales.

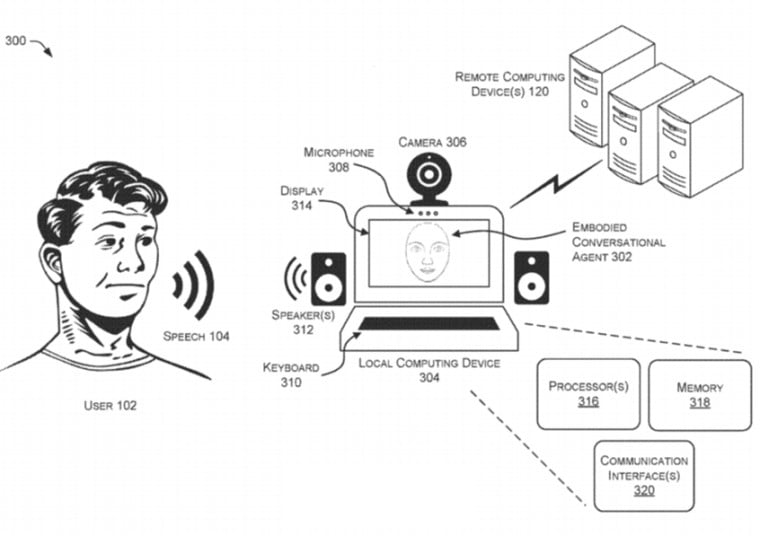

Esta nueva tecnología patentada tiene como objetivo ofrecer un agente de conversación basado en voz. Este participaría en un diálogo más natural, de múltiples estilos que se alinea con el estilo de conversación y las expresiones faciales de un usuario. Un agente de conversación que se implementa como un agente de solo voz o encarnado con una cara puede coincidir con el habla y las expresiones faciales de un usuario.

La coincidencia de estilo lingüístico por el agente conversacional se puede implementar identificando las características prosódicas del discurso del usuario y sintetizando el habla para el agente virtual con las mismas o similares características. Las expresiones faciales del usuario identifican e imitan la cara de un agente conversacional encarnado.

Las expresiones del agente virtual pueden basarse en una combinación de respuestas con scripts predeterminadas y respuestas abiertas generadas por técnicas de Machine Learning. Un agente conversacional que se alinea con el estilo conversacional y las expresiones faciales del usuario se percibe como más confiable. Haciéndolo más fácil de entender, y crear una interacción humano-máquina más natural.

El agente conversacional tendrá capacidad de solo audio o encarnado, lo que significa que tiene una «cara» que parece hablar. En ambas implementaciones, el agente puede utilizar técnicas de aprendizaje automático. Responder a las expresiones de un usuario de una manera natural y comprensible. Esto mejora las interacciones hombre-máquina en su conjunto.